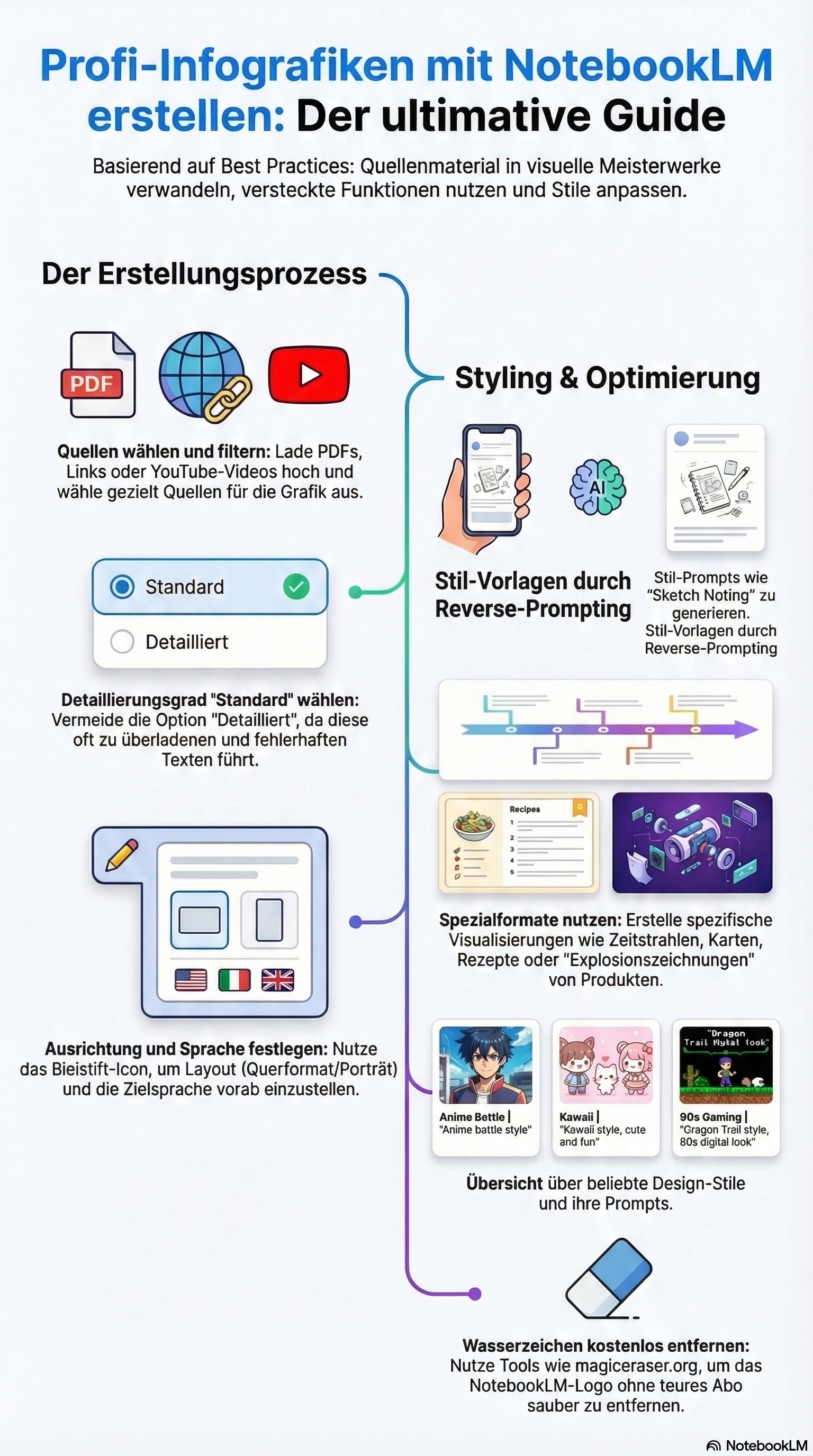

Als Senior IT-Architekt und passionierter Tech-Blogger evaluiere ich kontinuierlich neue Werkzeuge auf ihre Enterprise-Tauglichkeit und ihren Nutzen im Entwickler- und Design-Alltag. Ein Tool, das aktuell eine bemerkenswerte Evolution durchläuft, ist Googles NotebookLM. Es fungiert im Kern als ein RAG-System (Retrieval-Augmented Generation), das es Benutzern ermöglicht, durch gezieltes Prompt-Engineering und ohne jegliche Design-Erfahrung hochkomplexe, visuell ansprechende Infografiken zu generieren.

Im folgenden Architektur- und Praxis-Review analysiere ich die technischen Mechanismen, Parametrisierungen und Workarounds, um das volle Potenzial dieser Generative AI auszuschöpfen.

Inhaltsverzeichnis

- Inhaltsverzeichnis

- Die Basis-Architektur: Ingestion und Grounding

- Parametrisierung der Rendering-Engine

- Advanced Prompt-Engineering für visuelle Stile

- Post-Processing: Watermark-Removal und Clean-Up

- Spezifische Use Cases und Daten-Architektur

- Dynamische Quellen-Steuerung (Source Control)

- Tool-Stack-Exkurs: API-Aggregation mit "i 10X" (iTX)

- Fazit

Die Basis-Architektur: Ingestion und Grounding

Der erste kritische Schritt in jedem LLM-Workflow ist die Bereitstellung der Source of Truth. NotebookLM zeichnet sich dadurch aus, dass sämtliche hochgeladenen Informationen zum exklusiven Basiswissen (dem sogenannten Grounding Material) für das jeweilige "Notebook" werden.

Unter der URL notebooklm.google.com können Entwickler und Researcher verschiedenste Datenquellen in das System überführen.

Unterstützte Dateiformate und Quellen:

-

Lokale Dateien (insbesondere PDF-Dokumente).

-

Bilddateien (Images).

-

URLs und Links zu regulären Websites.

-

Links zu YouTube-Videos.

-

Direkte Integration von Google Drive-Dokumenten.

-

Manuell eingefügter, roher Text (Copied Text).

Ein klassisches Setup könnte beispielsweise die Erforschung von Wurmlöchern (Wormholes) sein, für die man spezifische YouTube-Links und Fachartikel als Basiswissen injiziert.

Parametrisierung der Rendering-Engine

Sobald der Vektor-Index mit den Quellen gefüllt ist, erfolgt die Generierung über den dedizierten "Infographics"-Button. Ein häufiger Anwenderfehler (Layer-8-Problem) ist es, hier sofort auf Generieren zu klicken. Um deterministischere und maßgeschneiderte Ergebnisse zu erhalten, muss zwingend das Stift-Symbol (Pencil Icon) für die erweiterten Einstellungen geöffnet werden.

Konfigurations-Parameter

Hier bietet die Schnittstelle tiefgreifende Steuerungsmöglichkeiten:

-

Sprachauswahl (Language): Festlegung der Output-Sprache aus einer Vielzahl von Optionen, wobei Englisch als robuster Standard gilt.

-

Ausrichtung (Orientation): Wahl zwischen Landscape (Querformat), Portrait (Hochformat) oder Square (Quadratisch), je nach Zielmedium (Präsentation vs. Mobile).

-

Detailgrad (Level of Detail): Hier stehen die Optionen Concise, Standard und Detailed zur Verfügung.

Architektur-Warnung zum Detailgrad: Als Best Practice hat sich herausgestellt, die Einstellung Detailed strikt zu vermeiden. Aus technischer Sicht versucht die Rendering-Engine bei dieser Einstellung, das Context Window visuell zu stark zu komprimieren. Das führt zu Fehlberechnungen bei der Text-Bild-Synthese, wodurch der generierte Text fehlerhaft ("wonky and off") gerendert wird. Die Empfehlung lautet daher, ausschließlich Standard oder Concise zu verwenden.

Advanced Prompt-Engineering für visuelle Stile

Der wichtigste Hebel im Prozess ist die Prompt Box, die nicht nur den Inhalt, sondern vor allem die visuelle Ästhetik (den Style) definiert.

Die "Reverse-Prompting" Methode

Um einen spezifischen Stil zu replizieren, empfehle ich folgenden Workflow:

-

Suchen Sie im Web oder auf Social Media nach einer ästhetisch passenden Referenz-Grafik.

-

Speichern Sie das Bild oder erstellen Sie einen Screenshot.

-

Laden Sie dieses Bild in einen multimodalen KI-Chatbot (wie z.B. Gemini) hoch.

-

Führen Sie den Prompt aus: "What style is this?" (Welcher Stil ist das?).

-

Extrahieren Sie die technische Stil-Beschreibung (z.B. "classic sketch noting") und nutzen Sie diese als direkten Input in der NotebookLM Prompt Box. Das Ergebnis ist eine nahezu perfekte stilistische Replikation.

Erprobte Style-Prompts (Checkliste)

Basierend auf tiefgehenden Tests haben sich folgende Prompts als extrem verlässlich und visuell beeindruckend erwiesen:

-

"classic sketch noting": Für einen handgezeichneten, skizzierten Look.

-

"Miniature world look with geometric shapes and blocky characters": Erzeugt eine isometrische, blockartige Miniaturwelt.

-

"chalkboard style": Klassische Schultafel-Optik.

-

"anime battle style": Ein hochdynamischer, an japanische Animationen angelehnter Look.

-

"tactile 3D style with inflated shapes": Moderne, haptisch wirkende 3D-Objekte.

-

"retro 90s gaming look" (oder einfach '90s): Perfekt für nostalgische oder technik-historische Daten.

-

"whiteboard": Sauberer, professioneller Brainstorming-Effekt.

-

"Kawaii" (K A W A I I): Ein sehr niedlicher, verspielter Illustrationsstil.

Post-Processing: Watermark-Removal und Clean-Up

Ein technischer Flaschenhals im kostenlosen Tier von NotebookLM ist das fest einkodierte Wasserzeichen (Watermark/Logo) unten rechts auf jeder exportierten Infografik. Für den Enterprise- oder professionellen Blog-Einsatz ist dies inakzeptabel.

Lösungsansätze:

-

Kostenpflichtiger Tier: Das Upgrade auf den Google AI Ultra Plan (Kostenpunkt: ca. 250 $ pro Monat) entfernt das Branding serverseitig.

-

Kostenloses Tooling (Workaround): Die Nutzung des Web-Tools magiceraser.org.

-

Workflow: Infografik hochladen -> Eraser Size (Pinselgröße) einstellen -> über das Logo markieren -> "Apply changes" klicken -> artefaktfreies Bild herunterladen.

Spezifische Use Cases und Daten-Architektur

NotebookLM limitiert Anwender nicht nur auf Standard-Diagramme. Durch geschicktes Prompting lassen sich komplexe Datenstrukturen visualisieren:

1. Geospatiale Visualisierungen (Maps)

Auch wenn es für ein Wurmloch-Notebook wenig Sinn ergibt, ist die Karten-Generierung extrem mächtig.

-

Beispiel 1: Eine Karte der besten Orte zum Fliegenfischen ("fly fishing") in den USA.

-

Beispiel 2: Eine Streckenkarte für das Marathon-Training, die exakt visualisiert, an welchen Punkten der Strecke Fueling (Wasser, Essen vor dem Rennen, Energy-Gels währenddessen) stattfinden muss.

2. Chronologische Datensätze (Timelines)

Zur Visualisierung historischer Verläufe (z.B. die Geschichte der Wurmloch-Forschung) lässt sich das gesamte hochgeladene Wissen in eine chronologische "Timeline" übersetzen, die Schritt für Schritt die Evolution eines Themas darstellt.

3. Personal Branding und Lebensläufe

Durch den Upload eines als PDF exportierten LinkedIn-Profils oder eines Lebenslaufs kann eine visuelle Karriere-Roadmap generiert werden. Ein hervorragender Styling-Tweak hierfür ist der Prompt "Oregon Trail", der dem Lebenslauf einen coolen, digitalen 90er-Jahre-Look verleiht.

4. Technische Diagramme und Datenvisualisierung

-

Exploded View Diagram: Ideal für Marktforschung oder Hardware-Analysen (z.B. "Wie werden iPhones hergestellt?"). Es generiert eine Explosionszeichnung der Komponenten.

-

Data Visualization: Bei quantitativen Daten, beispielsweise Statistiken zur AI Adoption (KI-Adaption), empfiehlt sich der Prompt "visualize the data" gepaart mit dem Stil "make it professional but futuristic style".

-

Rezept-Visualisierung: Für strukturierte Abläufe wie Back- oder Kochrezepte können atemberaubende Schritt-für-Schritt-Grafiken aus einem dedizierten Rezept-Notebook generiert werden.

Dynamische Quellen-Steuerung (Source Control)

Ein oft übersehener, aber architektonisch brillanter Mechanismus ist das Selective Source Routing. Befinden sich hunderte Quellen im Notebook, kann man in der linken Sidebar gezielt nur 1, 2 oder 3 spezifische Dokumente oder Videos ankreuzen. Die generierte Infografik greift dann bei der Generierung ausschließlich auf diese selektierten Quellen zu, was eine extreme Schärfung des Outputs ermöglicht.

Tool-Stack-Exkurs: API-Aggregation mit "i 10X" (iTX)

Da wir im IT-Architektur-Bereich stark mit Tool-Sprawl (Wildwuchs an Abonnements wie ChatGPT für 20 $, Claude für 20 $ etc.) zu kämpfen haben, lohnt sich ein Blick auf Aggregatoren. Die Plattform i 10X (auch iTX genannt) konsolidiert die wichtigsten Large Language Models (LLMs) und Generierungs-Engines in einem Workspace.

-

Pricing: Startet bei 8 $ pro Monat (bei jährlicher Abrechnung) bzw. 10 $ bei monatlicher Zahlung.

-

Integrierte Text-Modelle: OpenAI, Google, XAI, Anthropic, Deepseek. Ein Auto-Routing-Feature wählt auf Wunsch das beste Modell für den jeweiligen Prompt automatisch aus.

-

Bild-Generierungs-Modelle (Image Generation): GPD image 1.5, Nano Banana, Nano Banana Pro, Flux, Dolly.

-

Video-Generierungs-Modelle: Sora 2, Cling 1 version 1.6, Google Vo 3.1, Sora 2 Pro.

-

Chat Arena: Ein Feature für A/B-Testing, bei dem derselbe Prompt parallel an zwei verschiedene Modelle gesendet wird, um die Output-Qualität direkt zu vergleichen.

Fazit

Als IT-Architekt bewerte ich NotebookLM als ein außerordentlich mächtiges Werkzeug im Bereich der Visual AI. Die nahtlose Integration von RAG-Mechanismen mit Bildgenerierung ermöglicht es, komplexe, textlastige Datenarchitekturen ohne Umwege in konsumierbare visuelle Assets zu transformieren. Die Notwendigkeit, visuelle Parameter manuell zu tunen (Vermeidung des "Detailed"-Modus) und externe Workarounds für das Watermark-Removal (magiceraser.org) einzusetzen, zeigt zwar, dass sich das Tool noch in einer Reifephase befindet.

Dennoch ist der ROI (Return on Investment) enorm, besonders wenn man fortgeschrittene Techniken wie das Reverse Prompting via Gemini und die selektive Quellenauswahl beherrscht. Für Tech-Blogger, Data Scientists und Analysten ist dieses Setup aktuell ein absoluter Gamechanger, der durch weiterführende Formate wie Slide Decks zukünftig noch an Relevanz gewinnen wird.