Willkommen zurück in der architektonischen Schaltzentrale! Als Senior SAP Technology Consultant und langjähriger Beobachter der SAP-Infrastruktur-Evolution widme ich mich heute der strategisch wichtigsten Entscheidung, die IT-Leiter aktuell fällen müssen: Welcher Hyperscaler ist das optimale Fundament für das "Intelligent Enterprise"? Die Finanzdaten sprechen eine überdeutliche Sprache. Im ersten Quartal 2023 verzeichnete SAP einen Anstieg des Cloud-Umsatzes um 24 %, während sich der Free Cashflow nahezu verdoppelte. Die On-Premise-Ära, dominiert von monolithischen Rechenzentren und statischen 5-Jahres-Hardware-Sizings, ist Geschichte.

Unter strenger Einhaltung der Detailtiefe analysieren wir heute tiefgreifend die Vor- und Nachteile der großen Hyperscaler (AWS, Azure, GCP) und verknüpfen klassisches SAP Basis-Wissen mit modernen Cloud-nativen Architekturen, Storage-Technologien und Code-Konfigurationen.

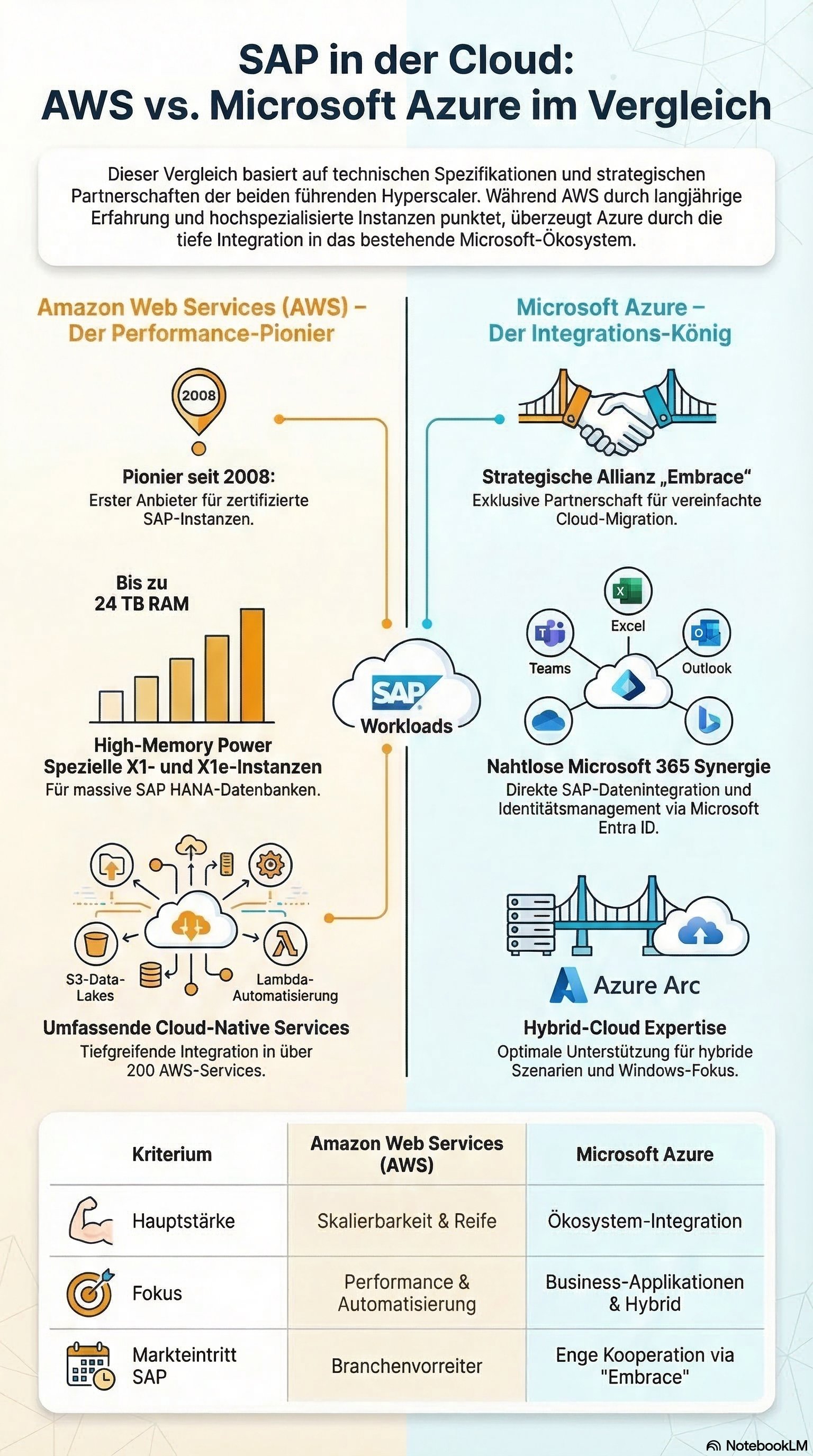

AWS: Der Pionier der SAP-Cloud-Architektur

Amazon Web Services (AWS) zertifizierte bereits 2008 als erster Anbieter SAP-Produktionsumgebungen. Diese historische Reife spiegelt sich in einer extrem robusten und granularen IaaS-Architektur (Infrastructure as a Service) wider.

Vorteile von SAP auf AWS:

-

AWS Nitro System: Der absolute architektonische Gamechanger. Die Nitro-Architektur verlagert Hypervisor-Funktionen (Netzwerk-I/O, Storage-Routing) auf dedizierte Hardware-Offload-Karten. Der enorme Vorteil: Die Amazon EC2-Instanzen stellen nahezu 100 % ihrer physischen CPU- und RAM-Ressourcen exklusiv der SAP-Applikation zur Verfügung. Ein Hypervisor-Overhead existiert de facto nicht.

-

Grenzenlose Skalierbarkeit (Compute): Für massiv speicherintensive SAP HANA In-Memory-Datenbanken bietet AWS die spezialisierten EC2 High Memory Instances (u- Instances basierend auf Intel Xeon Scalable Prozessoren). Diese liefern Bare-Metal-Performance für Scale-Up-Datenbanken von 3 TB bis hin zu 32 TB RAM in einer einzigen Instanz. Für SAP BW/4HANA (OLAP) lassen sich Scale-Out-Cluster mit bis zu 100 TB RAM provisionieren.

-

Storage-Performance: Die Bereitstellung von hochperformanten Block-Speichern via Amazon EBS (Elastic Block Store) mit

io2 Block Expressodergp3Volumes garantiert die strikte Einhaltung der SAP-KPIs (Latenzen zwingend unter 1ms für den HANA Log-Write/hana/log), um Sync-Delays zu verhindern.

Nachteile von SAP auf AWS:

- Geringere native Business-Ökosystem-Integration: Im Gegensatz zu Microsoft fehlt AWS die nahtlose, out-of-the-box Verzahnung mit allgegenwärtigen Corporate-Tools (wie Office 365, Teams oder einem dominanten Active Directory), was bei End-to-End-Prozessintegrationen zusätzlichen Middleware-Aufwand erfordern kann.

Azure: Die Macht der Integration und des Enterprise-Storages

Microsoft Azure positioniert sich durch die "Project Embrace"-Partnerschaft und tiefgreifende technologische Innovationen als massiver Konkurrent.

Vorteile von SAP auf Azure:

-

Azure NetApp Files (ANF): Dies ist der wohl signifikanteste technische Differentiator von Azure im Storage-Bereich. Während AWS oft auf Block-Storage setzt, ist ANF ein Enterprise-Grade File-Storage-Service, basierend auf Bare-Metal NetApp ONTAP-Fasern. ANF ermöglicht Shared Storage via NFSv4.1. Der Vorteil für alte Basis-Admins: Komplexe und fehleranfällige Linux-Pacemaker-Konfigurationen mit iSCSI-LUNs oder DRBD für SAP ASCS/ERS (ABAP SAP Central Services / Enqueue Replication Server) Cluster werden drastisch vereinfacht.

-

M-Series Virtual Machines & Write Accelerator: Azure setzt für hochskalierbare S/4HANA-Workloads auf die M-Serie (Mv2 und Mv3), die ebenfalls bis zu 32 TB RAM bereitstellen. Ein enormer Vorteil auf Architektur-Ebene ist der Write Accelerator, der auf Premium-Storage angewendet wird, um die sub-millisekunden Latenzen für das kritische

/hana/logzu garantieren. -

Natives Ökosystem: Native Integration in Microsoft Entra ID (ehemals Azure AD), PowerBI und M365 reduziert den Aufwand für Single Sign-On (SSO) und Data-Analytics erheblich.

Nachteile von SAP auf Azure:

- Komplexität im Storage-Design: Die Wahl zwischen Premium SSD v2, Ultra Disk und Azure NetApp Files erfordert ein extrem präzises, architektonisches Sizing. Eine Fehlkonfiguration der Storage-Tiers führt hier schnell zu signifikanten Performance-Engpässen oder unerwarteten Kostenspitzen.

GCP: Der Innovator im Hintergrund

Die Google Cloud Platform (GCP) wird oft als dritter Player genannt, besticht aber durch ein herausragendes Alleinstellungsmerkmal.

Vorteil von SAP auf GCP:

- Live-Migrationstechnologie: GCP verfügt über eine patentierte Live-Migration auf Compute-Ebene. Dies erlaubt es SAP-Basis-Administratoren, laufende, hochproduktive SAP HANA-VMs während physischer Hardware-Wartungsarbeiten im Rechenzentrum völlig ohne Downtime auf andere Hosts zu verschieben.

Evolution der Datensicherung: Altes Backup-Wissen vs. Cloud-Native Backint

Wir alle kennen noch das klassische Basis-Setup: Backups wurden über Tools wie BR*Tools lokal in Dateisysteme geschrieben und per Tivoli Storage Manager (TSM) oder Commvault auf physische Tape-Libraries ausgelagert. Die Recovery Time Objectives (RTO) waren extrem lang.

Heute wird dieses veraltete Design durch die SAP HANA Backint API ersetzt, die Datenbank-Streams ohne Filesystem-Umwege direkt in Cloud-Objektspeicher pumpt. Hier zeigen sich spezifische Vor- und Nachteile der Plattformen:

- AWS: Nutzt den AWS Backint Agent for SAP HANA. Vorteil: Direkter C++ Stream in Amazon S3, spart teuren EBS-Speicherplatz. Nachteil: Muss manuell als Agent auf der EC2-Instanz konfiguriert werden.

Um keine technischen Informationen zu kürzen, dokumentiere ich hier die zwingend erforderliche Konfiguration auf Datenbankebene in die global.ini:

[backup]

log_backup_using_backint = true

catalog_backup_using_backint = true

data_backup_parameter_file = /usr/sap/<SID>/SYS/global/hdb/opt/hdbconfig/aws-backint-agent-config.yaml

log_backup_parameter_file = /usr/sap/<SID>/SYS/global/hdb/opt/hdbconfig/aws-backint-agent-config.yaml

Und das zugehörige YAML-Mapping auf den Cloud-Storage (S3):

# AWS Backint Agent Configuration

S3BucketName: "arn:aws:s3:::my-sap-hana-backup-bucket"

S3Region: "eu-central-1"

S3StorageClass: "STANDARD"

KmsKey: "arn:aws:kms:eu-central-1:123456789012:key/alias/sap-backup-key"

LogFile: "/hana/shared/aws-backint-agent/aws-backint-agent.log"

-

Azure: Kontert hier mit einem massiven operationellen Vorteil. Azure Backup for SAP HANA ist ein vollintegrierter "Backup as a Service" im Azure Recovery Services Vault. Nachteil: Bindung an Azure-spezifische Vault-Restriktionen, aber überragender Vorteil bei der Verwaltung, da Point-in-Time-Recoveries (PiTR) direkt im Azure Portal auf die Sekunde genau gesteuert werden können – völlig ohne eigene Backup-Infrastruktur-Server und mit zuverlässigen 15-Minuten-RPOs (Recovery Point Objectives).

-

GCP: Bietet den Cloud Storage Backint agent, der durch hochgradige Parallelisierung und Verschlüsselung in Cloud Storage-Buckets punktet.

SAP BTP und Künstliche Intelligenz: Native Hyperscaler vs. SAP AI Core

Der Paradigmenwechsel vom monolithischen ABAP-Kern (Z-Namensraum) hin zum Clean Core zwingt Architekten, Erweiterungen Side-by-Side auf der SAP Business Technology Platform (BTP) auszulagern. Der brisanteste architektonische Konflikt besteht aktuell in der KI-Strategie:

-

SAP BTP AI Core: Der Vorteil liegt im direkten Business Data Context. Der AI Core versteht SAP-Semantik, Cloud Application Programming (CAP) und ERP-Berechtigungen out-of-the-box. Nachteil: Oft teurer und restriktiver in der Modellauswahl als direkte Hyperscaler-Dienste.

-

Hyperscaler Native (z.B. Azure OpenAI): Der immense Vorteil ist die rohe, ungedrosselte Rechenpower modernster LLMs wie GPT-4. Das aktuelle Best-Practice-Architekturdesign nutzt die in der BTP gehostete HANA Vector Engine als hochperformante Vektordatenbank (für Embeddings von Materialstämmen und Stücklisten), kombiniert mit einer RAG-Architektur (Retrieval-Augmented Generation) auf Azure OpenAI. Dies liefert kontextualisierte, halluzinationsfreie Antworten direkt aus dem ERP, erfordert aber einen höheren initialen Integrationsaufwand (Nachteil).

Fazit

Die detaillierte Analyse der Architektur-Daten zeigt unmissverständlich: Den "einen perfekten Hyperscaler" für SAP-Workloads gibt es nicht. Die Entscheidung muss granular auf Basis der bestehenden Enterprise-Architektur gefällt werden.

AWS ist der ungeschlagene Champion, wenn es um schiere, Hypervisor-befreite Compute-Performance (Nitro System) und langjährig erprobte Stabilität bei massiven Scale-Up- und Scale-Out-Datenbanken geht. Azure dominiert ganz klar durch seine Storage-Innovationen (Azure NetApp Files zur Eliminierung komplexer Pacemaker-Cluster) sowie durch die beispiellose native Integration in das Microsoft-Ökosystem und PaaS-Backup-Services. GCP glänzt als Spezialist mit Features wie der Live-Migration zur Minimierung von Hardware-Downtimes.

Für moderne SAP-Landschaften, die strikt nach dem Clean Core Prinzip agieren, wird ein intelligenter Multi-Cloud-Ansatz zum Standard. Das S/4HANA-Transaktionssystem auf den M-Series von Azure oder u-Instances von AWS, historische Daten in S3-Data-Lakes und die Orchestrierung modernster RAG-basierter KI-Modelle via SAP BTP – das ist das architektonische Meisterwerk, das ein zukunftssicheres "Intelligent Enterprise" definiert. Das alte Basiswissen um Storage-Latenzen, Pacemaker-Cluster und Backint-Interfaces ist der Schlüssel, um diese hochkomplexen Cloud-Netzwerke fehlerfrei und performant zu designen.